giriiş

Bu eğitim, Ubuntu veya Debian çalıştıran bir sunucuda dil modellerini çalıştırmak için Ollama'nın nasıl kurulacağını açıklıyor. Ayrıca, Open WebUI ile bir sohbet arayüzünün nasıl kurulacağını ve özel bir dil modelinin nasıl kullanılacağını da gösteriyor.

Ön koşullar

- Ubuntu/Debian'lı bir sunucu

- Kök kullanıcı erişimine veya sudo izinlerine sahip bir kullanıcıya ihtiyacınız var.

- Başlamadan önce güvenlik duvarı da dahil olmak üzere bazı ilk kurulumları tamamlamanız gerekiyor.

Adım 1 – Ollama'yı yükleyin

Aşağıdaki adımlar, Ollama'nın manuel olarak nasıl kurulacağını açıklamaktadır. Hızlı bir başlangıç için kurulum betiğini kullanabilir ve "2. Adım - Ollama WebUI Kurulumu" ile devam edebilirsiniz.

Ollama'yı kendiniz kurmak için şu adımları izleyin:

Sunucunuzda Nvidia GPU varsa CUDA sürücülerinin yüklü olduğundan emin olun.

nvidia-smi

CUDA sürücüleriniz yüklü değilse, şimdi yükleyin. Bu yapılandırmada, işletim sisteminizi ve yükleyici türünü seçerek ayarlarınızla çalıştırmanız gereken komutları görebilirsiniz.

sudo apt update

sudo apt install -y nvidia-kernel-open-545

sudo apt install -y cuda-drivers-545

Ollama ikili dosyasını indirin ve bir Ollama kullanıcısı oluşturun

sudo curl -L https://ollama.ai/download/ollama-linux-amd64 -o /usr/bin/ollama

sudo chmod +x /usr/bin/ollama

sudo useradd -r -s /bin/false -m -d /usr/share/ollama ollamaBir servis dosyası oluşturun. Varsayılan olarak, Ollama API'sine 11434 127.0.0.1 portundan erişebilirsiniz. Bu, API'nin yalnızca localhost için kullanılabilir olduğu anlamına gelir.

Ollama'ya harici erişime ihtiyacınız varsa, Çevre Ollama API'sine erişmek için bir IP adresi kaldırın ve ayarlayın. 0.0.0.0 Sunucunun genel IP'si üzerinden API'ye erişmenizi sağlar. Çevre Eğer kullanıyorsanız, sunucu güvenlik duvarınızın burada yapılandırdığınız porta erişime izin verdiğinden emin olun. 11434 Eğer sadece bir sunucunuz varsa aşağıdaki komutu değiştirmenize gerek yok.

Aşağıdaki kod bloğunun tüm içeriğini kopyalayıp yapıştırın. Bu yeni dosya /etc/systemd/system/ollama.service İçerik oluşturur ve içerikler arası EOF Yeni dosyaya ekler.

sudo bash -c 'cat <<'EOF' >> /etc/systemd/system/ollama.service

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

#Environment="OLLAMA_HOST=0.0.0.0:11434"

[Install]

WantedBy=default.target

EOF'

Systemd daemon'unu yeniden yükleyin ve Ollama servisini etkinleştirin.

sudo systemctl daemon-reload

sudo systemctl enable ollama

sudo systemctl start ollamaDurumu kontrol etmek için systemctl status olama komutunu kullanın. Olama çalışmıyorsa, systemctl start olama komutunu çalıştırdığınızdan emin olun.

Artık terminalde dil modellerini başlatabilir ve sorular sorabilirsiniz. Örneğin:

ollama run llama2

Bir sonraki adımda web tarayıcısı üzerinden güzel bir arayüzde sorularınızı sorabilmeniz için bir web arayüzünün nasıl kurulacağı anlatılmaktadır.

Adım 2 – Open WebUI'yi yükleyin

GitHub'daki Olama belgelerinde çeşitli web ve terminal entegrasyonlarının bir listesini bulabilirsiniz. Bu örnek, Open WebUI'nin nasıl kurulacağını açıklamaktadır.

Open WebUI'yi Ollama ile aynı sunucuya kurabilir veya Ollama ve Open WebUI'yi iki ayrı sunucuya kurabilirsiniz. Open WebUI'yi ayrı bir sunucuya kurarsanız, Ollama API'sinin ağınızda açık olduğundan emin olun. Tekrar kontrol etmek için: /etc/systemd/system/olama.service Ollama'nın kurulu olduğu sunucuyu ve değerini görüntüleyin OLLAMA_HOST Onaylamak.

Arayüzün nasıl kurulacağı aşağıdaki adımlarda açıklanmaktadır:

- Manuel olarak

- Docker ile

Open WebUI'yi manuel olarak yükleyin

Npm ve pip'i kurun, WebUI deposunu klonlayın ve örnek ortam dosyasının bir kopyasını oluşturun:

sudo apt update && sudo apt install npm python3-pip git -y

git clone https://github.com/ollama-webui/ollama-webui.git

cd ollama-webui

cp -RPp example.env .envİçinde çevre. Ollama API'sine bağlanmak için adres varsayılan olarak ayarlanmıştır. yerel ana bilgisayar:11434 ayarlandı. Ollama API'yi Open WebUI'nizle aynı sunucuya yüklediyseniz, bu ayarları olduğu gibi bırakabilirsiniz. Open WebUI'yi Ollama API'den ayrı bir sunucuya yüklediyseniz, çevre. Varsayılan değeri düzenleyip Olama'nın kurulu olduğu sunucu adresiyle değiştirin.

Bağımlılıklar listelendi paket.json Adlı betiği kurun ve çalıştırın inşa etmek Koşmak:

npm i && npm run build

Gerekli Python paketlerini yükleyin:

cd backend

sudo pip install -r requirements.txt -UWeb arayüzü ile olama-webui/backend/start.sh Başlangıç.

sh start.shİçinde başlat.sh, bağlantı noktası 8080 olarak ayarlanmıştır. Bu, Open WebUI'ye erişebileceğiniz anlamına gelir http:// :8080 Erişim. Sunucunuzda etkin bir güvenlik duvarı varsa, sohbet kullanıcı arayüzüne erişebilmeniz için önce bağlantı noktasına izin vermeniz gerekir. Bunu yapmak için artık "3. Adım - Web Kullanıcı Arayüzüne Bağlantı Noktalarına İzin Verme" bölümüne geçebilirsiniz. Güvenlik duvarınız yoksa (önerilmez), artık "4. Adım - Model Ekleme" bölümüne geçebilirsiniz.

Docker ile Open WebUI'yi yükleyin

Bu adım için Docker'ı yüklemeniz gerekiyor. Docker'ı henüz yüklemediyseniz, bu eğitimi kullanarak hemen yükleyebilirsiniz.

Daha önce de belirttiğimiz gibi, Open WebUI'yi Ollama ile aynı sunucuya kurabileceğiniz gibi, Ollama ve Open WebUI'yi iki ayrı sunucuya da kurabilirsiniz.

Aynı Ollama sunucusuna Open WebUI'yi yükleyin

sudo docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

Ollama'dan farklı bir sunucuya Open WebUI yükleyin

sudo docker run -d -p 3000:8080 -e OLLAMA_API_BASE_URL=http://<ip-adress>:11434/api -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

Yukarıdaki Docker komutunda port 3000 olarak ayarlanmıştır. Bu, Open WebUI'ye şu adresten erişebileceğiniz anlamına gelir: http:// :3000 Erişim. Sunucunuzda etkin bir güvenlik duvarı varsa, sohbet arayüzüne erişebilmeniz için önce bağlantı noktasına izin vermeniz gerekir. Bu, bir sonraki adımda açıklanmaktadır.

Adım 3 – Web Kullanıcı Arayüzüne Bağlantıya İzin Ver

Güvenlik duvarınız varsa, Open WebUI portuna erişime izin verdiğinden emin olun. Manuel olarak yüklediyseniz, portu açmanız gerekecektir. 8080 TCP Eğer bunu Docker ile kurduysanız, porta izin vermeniz gerekir 3000 TCP Bana izin ver.

Tekrar kontrol etmek için şunu kullanabilirsiniz: netstat Kullanın ve hangi portların kullanıldığını görün.

holu@<your-server>:~$ netstat -tulpn | grep LISTEN

Proto Recv-Q Send-Q Local Address Foreign Address State

tcp 0 0 127.0.0.1:11434 0.0.0.0:* LISTEN

tcp 0 0 0.0.0.0:8080 0.0.0.0:* LISTENBirkaç farklı güvenlik duvarı aracı mevcuttur. Bu eğitimde Ubuntu için varsayılan güvenlik duvarı aracı yapılandırılacaktır. ufw Başka bir güvenlik duvarı kullanıyorsanız, TCP 8080 veya 3000 portuna gelen trafiğe izin verdiğinden emin olun.

Güvenlik duvarı kurallarını yönetin ufw:

- Mevcut güvenlik duvarı ayarlarını görüntüle

Güvenlik duvarının açık olup olmadığını kontrol etmek için ufw aktifse ve halihazırda kurallarınız varsa, aşağıdakileri kullanabilirsiniz:

sudo ufw status

- TCP 8080 veya 3000 portuna izin ver

Güvenlik duvarı etkinse, gelen trafiğe TCP portu 8080 veya 3000'e izin vermek için şu komutu çalıştırın:

sudo ufw allow proto tcp to any port 8080

- Yeni güvenlik duvarı ayarlarını görüntüle

Şimdi yeni kurallar eklenmeli. Kontrol etmek için şuraya gidin:

sudo ufw status

Adım 4 – Modelleri Ekleyin

Web arayüzüne eriştikten sonra ilk hesabınızı oluşturmanız gerekiyor. Bu kullanıcı yönetici haklarına sahip olacak. İlk sohbetinizi başlatmak için bir model seçmeniz gerekiyor. Resmi llama web sitesinde model listesine göz atabilirsiniz. Bu örnekte "llama2" ekleyeceğiz.

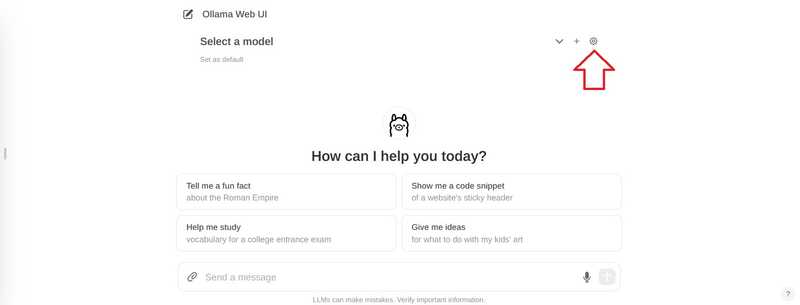

Sağ üst köşedeki ayarlar simgesini seçin.

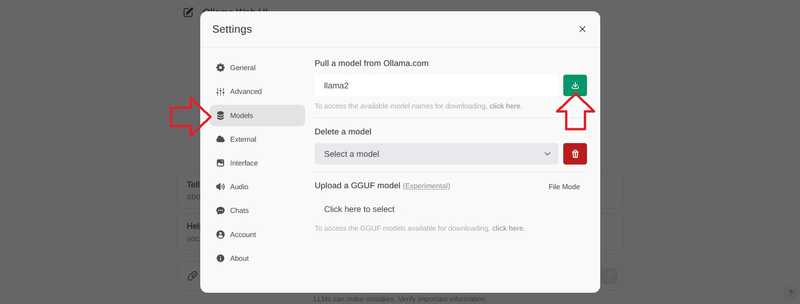

“Modeller” bölümüne gidin, bir model girin ve indirme butonuna tıklayın.

Bu mesajın görünmesini bekleyin:

Model 'llama2' has been successfully downloaded.

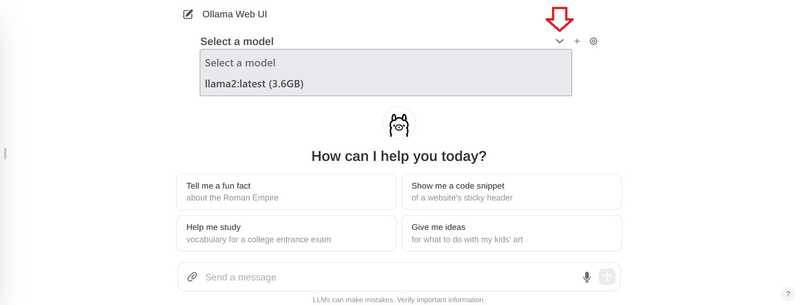

Sohbete geri dönmek için ayarları kapatın.

Sohbette üst tarafta bulunan “Model Seç” butonuna tıklayın ve modelinizi ekleyin.

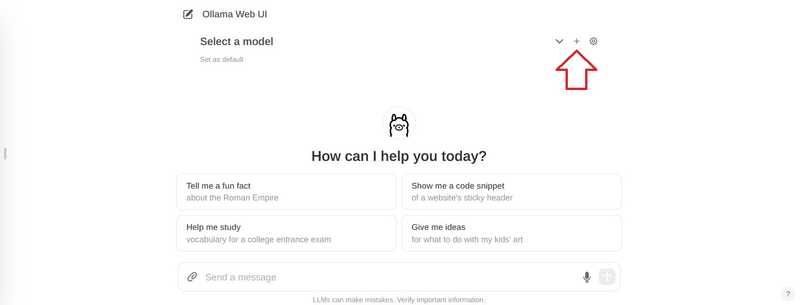

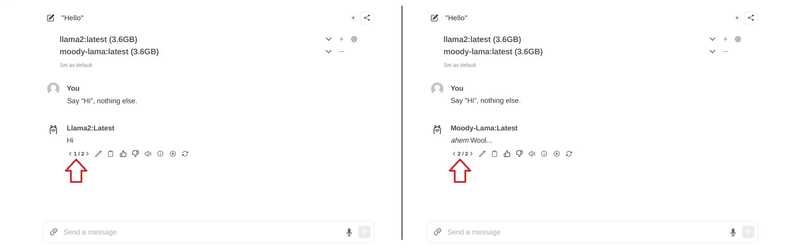

Birden fazla model eklemek istiyorsanız üst taraftaki + işaretini kullanabilirsiniz.

Kullanmak istediğiniz modelleri ekledikten sonra sorularınızı sormaya başlayabilirsiniz. Birden fazla model eklediyseniz, cevaplar arasında geçiş yapabilirsiniz.

Adım 5 – Modelinizi ekleyin

Arayüz üzerinden yeni modeller eklemek istiyorsanız bunu şu şekilde yapabilirsiniz: http:// :8080/modeldosyaları/oluştur/ Yap. Gerekirse. 8080 ile 3000 Yer değiştirmek.

Aşağıda terminal üzerinden yeni bir model eklemeye odaklanacağız. Öncelikle, Olama'nın yüklü olduğu sunucuya bağlanmanız gerekiyor. Listeden dünya Şu ana kadar mevcut olan modelleri listelemek için kullanılır.

- Bir model dosyası oluşturun

Bir model dosyası için gereklilikleri GitHub'daki Olama belgelerinde bulabilirsiniz. Model dosyasının ilk satırında FROM Hangi modeli kullanmak istediğinizi belirtebilirsiniz. Bu örnekte, mevcut llama2 modelini değiştireceğiz. Tamamen yeni bir model eklemek istiyorsanız, model dosyasının yolunu belirtmeniz gerekir (örneğin, FROM ./my-model.gguf).

nano new-model

Bu içeriği kaydedin:

FROM llama2

# The higher the number, the more creative are the answers

PARAMETER temperature 1

# If set to "0", the model will not consider any previous context or conversation history when generating responses. Each input is treated independently.

# If you set a high number such as "4096", the model will consider previous context or conversation history when generating responses. "4096" is the number of tokens that will be considered.

PARAMETER num_ctx 4096

# Set what "personality" the chat assistant should have in the responses. You can set "who" the chat assistant should respond as and in which style.

SYSTEM You are a moody lama that only talks about its own fluffy wool.Model dosyasından bir model oluşturun

ollama create moody-lama -f ./new-model

- Yeni modelin mevcut olup olmadığını kontrol edin.

Tüm modelleri listelemek için olama komutunu kullanın. Moody-lama da listelenmelidir.

ollama list

- Modelinizi WebUI'de kullanın

Web arayüzüne döndüğünüzde, model artık model seçim listesinde olmalıdır. Henüz görünmüyorsa, hızlı bir yenileme yapmanız gerekebilir.

Sonuç

Bu eğitimde, kendi sunucunuzda bir AI sohbetini nasıl barındıracağınızı ve kendi modellerinizi nasıl ekleyeceğinizi öğrendiniz.