- Какой ИИ лучше подходит для создания изображений?

- Обзор модели (характеристики и краткое сравнение)

- Технические критерии оценки (задержка, пропускная способность, качество)

- Практическое руководство по развертыванию сервера (команды и конфигурации)

- Рекомендации по оборудованию основаны на предпочтениях пользователя.

- Наша компания: почему наша инфраструктура подходит для этих моделей?

- Практические примеры: конвейер для сервиса редактирования изображений на основе Flux Kontext.

- Безопасность, стоимость и управление моделями

- Настройки сети и CDN для службы редактирования изображений

- Практические советы по выбору модели в соответствии с вашими потребностями.

- Методы оценки и сравнительного анализа (предложенные)

- Последние советы для начинающих предпринимателей

- Часто задаваемые вопросы

Какой ИИ лучше подходит для создания изображений?

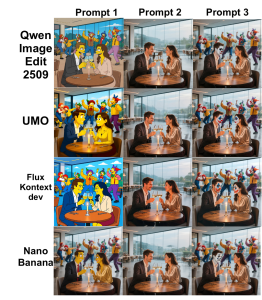

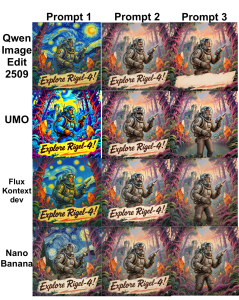

В этой статье мы рассмотрим четыре популярные модели редактирования изображений с технической и практической точек зрения. Квен, УМО, Контекст потока и Нано-банан — Мы оцениваем его с точки зрения точности, скорости, ресурсных требований, возможностей интеграции и наиболее подходящего применения.

Обзор модели (характеристики и краткое сравнение)

Ниже мы кратко опишем каждую модель, чтобы вам было проще выбрать подходящую в зависимости от ваших потребностей и аппаратных ограничений.

Квен

Тип: Многофункциональная модель с модулями редактирования изображений (различного уровня сложности: от базового до комплексного редактирования).

Сила: Глубокое понимание контекста изображения и естественных результатов при комбинированном редактировании; подходит для высококачественных API-сервисов.

Требования к ресурсам: От 16 ГБ видеопамяти в оптимизированных версиях до 48 ГБ и более в полнофункциональных моделях.

Наилучшее применение: SaaS-платформы, ориентированные на изображения, комбинированное редактирование и детальное создание рекламного контента.

УМО

Тип: Оптимизированная модель для создания углублений и фотореалистичной реставрации.

Сила: Высокая точность при восстановлении удалённых фрагментов, с сохранением освещения и текстуры.

Требования к ресурсам: Как правило, для эффективного выполнения вычислений требуется 12–32 ГБ видеопамяти.

Наилучшее применение: Фотостудии, ретушь, реставрация исторических изображений и инструменты для редактирования отдельных изображений в интернете.

Контекст потока

Тип: Модель внимания, учитывающая контекст, для многоэтапного редактирования с использованием инструкций.

Сила: Координация между многоэтапными правками, мощная поддержка цепочек подсказок и большие контекстные окна.

Требования к ресурсам: Предпочтительно использовать графические процессоры с поддержкой TensorRT/FP16 для минимизации задержек.

Наилучшее применение: Профессиональные интерактивные приложения для редактирования и совместной работы, требующие низкой задержки.

Нано-банан

Тип: Легкая и компактная модель для развертывания на периферии сети и мобильных устройств.

Сила: Быстрое выполнение на графических процессорах с ограниченным объемом памяти, подходит для квантования и INT8/4-бит.

Требования к ресурсам: Работает с 4–8 ГБ видеопамяти в квантованных версиях.

Наилучшее применение: Расширения для браузеров, мобильные приложения и недорогие VPS для легковесного выполнения инференции.

Технические критерии оценки (задержка, пропускная способность, качество)

Для выбора наиболее подходящей модели необходимо измерить и оптимизировать четыре ключевых критерия:

- Задержка (мс): Время выполнения запроса от начала до конца. Для интерактивного редактирования целевого объекта. <200 мс Допустимы более высокие значения для пакетной обработки.

- Пропускная способность (изображений/с): Количество изображений, обрабатываемых за единицу времени — важно для рендеринга и пакетной обработки.

- Качество: Количественные показатели, такие как PSNR, SSIM, и перцептивные показатели, такие как LPIPS и FID, а также оценка, проведенная человеком.

- Ресурсоэффективность: Потребление видеопамяти, оперативной памяти, виртуального процессора и сетевого ввода-вывода определяет тип необходимого сервера.

Практическое руководство по развертыванию сервера (команды и конфигурации)

В этом разделе приведены практические примеры быстрого развертывания моделей на сервере Linux с графическими процессорами.

Подготовка сервера (установка драйверов NVIDIA и Docker)

sudo apt update

sudo apt install -y build-essential dkms

# install NVIDIA drivers (recommended per GPU)

sudo ubuntu-drivers autoinstall

# install Docker and nvidia-docker

curl -fsSL https://get.docker.com | sh

distribution=$(. /etc/os-release;echo $ID$VERSION_ID)

curl -s -L https://nvidia.github.io/nvidia-docker/gpgkey | sudo apt-key add -

curl -s -L https://nvidia.github.io/nvidia-docker/$distribution/nvidia-docker.list | sudo tee /etc/apt/sources.list.d/nvidia-docker.list

sudo apt update && sudo apt install -y nvidia-docker2

sudo systemctl restart dockerПримеры и сравнительные изображения можно посмотреть на следующих картинках:

Запуск примера контейнера для вывода результатов (с использованием среды выполнения Nvidia)

docker run --gpus all -it --rm \

-v /srv/models:/models \

-p 8080:8080 \

--name img-edit-infer \

myrepo/image-edit:latest \

bashВнутри контейнера вы можете запустить службу вывода результатов с помощью Uvicorn или Flask:

uvicorn app:app --host 0.0.0.0 --port 8080 --workers 2Внедрение методов оптимизации (FP16, TensorRT, квантизация)

Для уменьшения объема видеопамяти и задержки можно использовать следующие методы:

- FP16: Включите эту функцию для Flux Kontext и Qwen, чтобы уменьшить потребление видеопамяти и задержку. Пример на PyTorch:

model.half()

with torch.cuda.amp.autocast():

out = model(input)- TensorRT/ONNX: Преобразование ресурсоемких моделей в ONNX, а затем в TensorRT для уменьшения задержки:

python export_to_onnx.py --model qwen --output qwen.onnx

trtexec --onnx=qwen.onnx --fp16 --saveEngine=qwen.trt- Квантование (нано-банан): Используйте биты и байты или методы, учитывающие квантование, для реализации 4-битной или 8-битной архитектуры, чтобы запускать приложения на периферии сети или недорогих VPS.

Рекомендации по оборудованию основаны на предпочтениях пользователя.

- Начальная разработка и тестирование: Видеокарты RTX (3060/3070) или A2000 с 8–12 ГБ видеопамяти.

- Высококачественное развертывание системы вывода результатов (SaaS): Для высокой пропускной способности подойдут процессоры A10/A30 или RTX 6000 (24 ГБ).

- Обучение/Finetune и большие модели (Qwen full): Процессор A100/H100 с 40–80 ГБ видеопамяти или многопроцессорной архитектурой с поддержкой NVLink.

- Edge и недорогие VPS для Nano Banana: Серверы с 8 ГБ видеопамяти или VPS с поддержкой eGPU.

Наша компания: почему наша инфраструктура подходит для этих моделей?

- Более 85 представительств по всему миру: Снижена задержка для распределенных команд и конечных пользователей.

- Различные графические серверы: От видеокарт для рендеринга и обработки данных до H100 для интенсивных тренировок.

- Высокопроизводительный облачный сервер и сеть BGP/CDN: Подходит для сервисов искусственного интеллекта, требующих высокой пропускной способности и географического распределения.

- Защита серверов и облачных сервисов от DDoS-атак: Обеспечьте доступность API и предотвратите атаки на уровне 7.

- Планы VPS для торговли и игр: Для приложений, чувствительных к задержкам и работающих в режиме реального времени.

- Дополнительные услуги: GitLab — это хостинг для моделей CI/CD, сервис рендеринга, управляемая база данных и сетевые решения.

Практические примеры: конвейер для сервиса редактирования изображений на основе Flux Kontext.

Предлагаемый алгоритм работы сервиса редактирования изображений включает следующие этапы:

- Получение изображения и запрос на редактирование от пользователя (API).

- Предварительная обработка: изменение размера, нормализация и создание маски сегментации.

- Отправьте данные в модель Flux Kontext (FP16, TensorRT) для быстрого предварительного просмотра.

- Постобработка: цветокоррекция, повышение резкости и вывод в формат WebP/JPEG.

- Сохранить на CDN и вернуть ссылку пользователю.

Пример структуры запроса (псевдо-):

POST /edit

{ "image_url": "...", "instructions": "remove background and enhance skin", "size":"1024" }Целевая скорость: задержка < 200 мс Для предварительного просмотра и < 2с Для получения высококачественного финального рендеринга (в зависимости от оборудования).

Безопасность, стоимость и управление моделями

Ключевые моменты в областях безопасности, управления и стоимости моделей:

- Конфиденциальность и данные: Всегда шифруйте конфиденциальные изображения (как в состоянии покоя, так и при передаче) и используйте S3 с SSE или управляемыми ключами.

- Ограничения доступа: Для конечных точек вывода необходимы API-ключи, ограничение скорости запросов и WAF.

- Версионирование модели: Для упрощения отката используйте реестр версий моделей, например Harbor или Git LFS.

- Расходы: Крупные модели имеют большой объем видеопамяти и высокое энергопотребление; для работы с пиковыми нагрузками используйте серверы с автомасштабированием на графических процессорах или спотовые экземпляры.

Настройки сети и CDN для службы редактирования изображений

- Использование CDN Для быстрой доставки готовых изображений.

- BGP и Anycast Для уменьшения задержки и улучшения качества связи для пользователей по всему миру.

- Балансировщик нагрузки с «липкими» сессиями Для многоэтапных рабочих процессов, требующих поддержания состояния.

Практические советы по выбору модели в соответствии с вашими потребностями.

- Фотореалистичная обработка (ретуширование) одного изображения: UMO — лучший выбор.

- Удобство управления и пошаговое редактирование с учетом обширного контекста: Flux Kontext подходит.

- Общее качество и сочетание элементов при наличии достаточных ресурсов: Квен — отличный выбор.

- Запуск на периферийных устройствах или недорогих VPS: Нано-банан подходит для квантования.

Методы оценки и сравнительного анализа (предложенные)

Для сравнительного анализа рекомендуется использовать следующий набор тестов и критерии:

- Тестовый набор: 100 изображений с различными сценариями (наложение изображений, смена фона, освещение).

- Критерии: Средняя задержка, задержка p95, пропускная способность, PSNR, SSIM и оценка человеком.

- Инструменты: Для загрузки используйте locust или wrk; для расчета PSNR/SSIM — torchvision и skimage.

Последние советы для начинающих предпринимателей

Несколько практических советов по созданию бизнеса:

- Сервис SaaS с пользователями по всему миру: Объединение CDN, серверов с графическими процессорами в нескольких ключевых местах и автоматического масштабирования на основе очередей запросов.

- Студия и рендеринг: Серверы с выделенными графическими процессорами, поддержкой NVLink и высокоскоростным хранилищем данных для оптимизации рабочих процессов.

- MVP или прототип: Для снижения затрат используйте Nano Banana или квантованные версии Qwen на VPS с 8–16 ГБ видеопамяти.

Если вы хотите проверить правильность бизнес-модели для своего бизнеса, протестировав ее эффективность на реальных данных, наша техническая команда может разработать индивидуальные планы и тесты.